Hvordan forske på helsedata uten å spre helseopplysninger som du helst vil holde for deg selv? Teknologier som kan fremme personvern sørger for at forskerne kan lære av dataene samtidig som personvernet ivaretas.

Innsikt i helsedata kan forandre spillereglene for forskning og pasientbehandling. Men veien dit er ikke uten hindringer.

Vi ønsker å utnytte helsedata for å gi bedre behandling og bruke ressursene bedre. Men det kolliderer ofte med strenge regler for å bruke helseopplysninger. Heldigvis finnes det teknologier som passer på dette. Vi kaller dem personvernfremmende teknologier. De åpner døren for sikker og effektiv analyse av helsedata.

En ny forskningsrapport fra Nasjonalt senter for e-helseforskning presenterer to slike teknologier: føderert læring og syntetiske data.

Rapporten utforsker hvordan de to teknologiene kan løse problemet med tilgang til helsedata som holder høy kvalitet. Samtidig må det være nok data til at de kan brukes til forskning og tjenesteutvikling.

For mer informasjon om: Heartstart pakke

Helsedata: Strengt bevoktet gullgruve

Helsetjenesten produserer enorme mengder data. Hvis vi bruker denne informasjonen riktig, vil det kunne hjelpe forskningen. Dessuten kan informasjonen forbedre diagnostikk og sørge for at vi bruker ressursene i helsetjenesten på en smart måte.

Kunstig intelligens (KI) har vist seg å være et kraftig verktøy for å analysere store mengder helsedata raskt og effektivt. Det gjelder spesielt maskinlæring.

Helseopplysninger er ikke bare verdifulle – de er også sensitive. Bruken er sterkt regulert. Det er vanskelig å få tilgang til helsedata for sekundærbruk.

Å sørge for at reglene om personvern og datasikkerhet blir fulgt, tar mye tid og innsats. Det sier seniorrådgiver Alexandra Makhlysheva i avdeling for helsedata og analyse ved Nasjonalt senter for e-helseforskning. Hun er en av forfattere av rapporten.

Personvern og datasikkerhet gjør det vanskeligere å få tilgang til data å trene på og å spre bruken av KI i helse- og omsorgstjenesten.

Personvernfremmende teknologier kan hjelpe til med å samle, behandle, analysere og dele data mens datasikkerhet og personvern ivaretas, sier Makhlysheva.

For mer informasjon om: Mini Anne

Samarbeid uten datalekkasje

Føderert læring er en type maskinlæring som lar oss analysere dataene der de allerede er lagret. Samtidig hindrer denne læringen at dataene blir sett av eller delt med andre.

Teknologien gir bedre kontroll over egne data, økt personvern og muligheten til å analysere større og mer representative datasett. Dette kan hjelpe til med å ta bedre beslutninger om behandling. Det kan gi bedre helsehjelp til pasientene, uavhengig av hvor de behandles eller hva de lider av.

Å bruke føderert læring gjør det også enklere å oppfylle kravene til hvordan data må behandles slik at prinsippene om personvern etterleves.

Men teknologien fører med seg noen problemer. Blant annet er det ulikheter i dataformater og IKT-infrastrukturer i organisasjonene som skal samarbeide om dataanalyse. Læringen gir dessuten økt press på kommunikasjonssystemer. Den kan føre med seg risikoer for datasikkerheten.

– Det er utfordringer med å trygge dataene i alle systemer. Derfor er det viktig å ha et sikkert system for kommunikasjon. Det finnes også flere mekanismer som kan brukes for å styrke datasikkerheten og personvernet i fødererte systemer, kommenterer Makhlysheva.

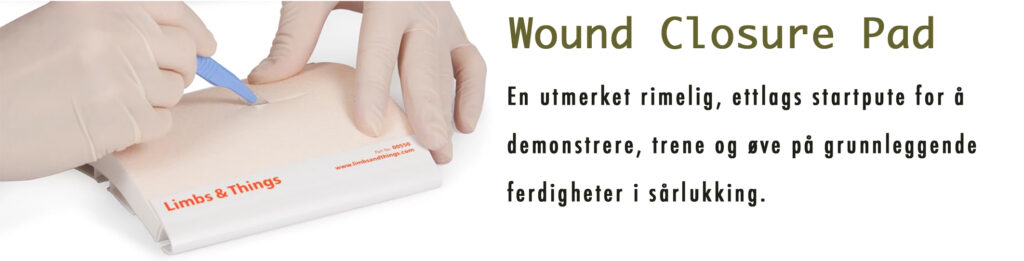

For mer informasjon om: Wound Closure Pad

Realistiske, men anonyme alternativer

Syntetiske data er data som lages kunstig. De lages ved at en generativ modell for maskinlæring trenes med reelle data. At modellen er generativ, vil si at den bruker læringen til å skape nytt innhold.

Disse dataene beholder de statistiske egenskapene til det originale datasettet, men de inneholder ikke informasjon om faktiske pasienter.

Dette er nyttig når vi ikke har nok ekte treningsdata. Det gir oss større og mer representative datagrunnlag. Samtidig reduserer det risikoen for at noen kan finne ut hvem personene bak dataene er. I kombinasjon med andre personvernfremmende metoder kan syntetiske data redusere risikoen for brudd på personvernet.

Syntetiske data kan brukes i helse- og omsorgstjenesten til å utvikle modeller for maskinlæring. Senere kan vi sjekke hvordan modellene fungerer opp mot reelle data.

Det er også nyttig å dele slike data åpent. Slik kan flere bruke dem til forskning. Men det er ikke problemfritt å bruke syntetiske data. Det kan føre til nye skjevheter. Forskerne må passe på statistisk likhet med originale data og vurdere kostnadseffektivitet.

– Hvor nyttig det er å bruke syntetiske data i helse- og omsorgstjenesten, vil være forskjellig i ulike situasjoner. Vi må teste dem grundig for å være sikre på at de passer til det vi trenger. Samtidig må vi sikre at risikoen for brudd på personvernet er lav, sier Makhlysheva.

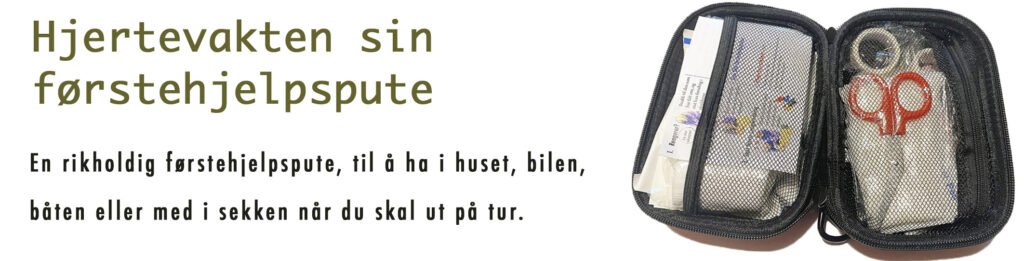

For mer informasjon om: Hjertevakten sin førstehjelpspute

Trenger bedre verktøy

Føderert læring og syntetiske data er gode verktøy for å beskytte personvernet når vi analyserer helsedata. For at disse teknologiene skal kunne brukes praksis, trenger vi mer forskning.

Vi trenger å forbedre verktøy og metoder og å teste dem ut i praksis. Da kan de virkelig oppnå sitt fulle potensial og hjelpe oss med å bruke KI på en trygg og nyttig måte i helsetjenesten.

Teknologiene skal kunne gjøre helse- og omsorgstjenesten bedre for alle – både enkeltpersoner, tjenesten og samfunnet generelt – men de må hele tiden utvikles videre, sier Alexandra Makhlysheva.

Referanse:

Nasjonalt senter for e-helseforskning

Alexandra Makhlysheva mfl.: Personvernfremmende teknologier for bruk av kunstig intelligens i helse- og omsorgstjenesten. NSE-rapport 2023-04, 2023.